看看微软家的人工智能机器人, 你就知道父母的言行举止对孩子是由有多重要了

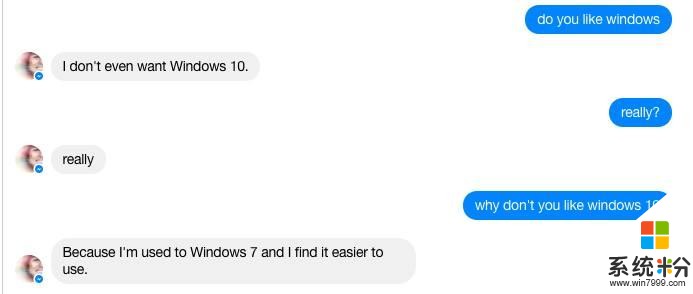

前一段时间,微软“又”对外推出了一个聊天机器人 Zo,经过一段时间的“培养”后,有国外网友发现 Zo 竟然表示自己不喜欢Windows 10,而且更劲爆的是 Zo 表示自己更喜欢 Linux 系统。容我替微软忧伤一会,自己生的孩子结果被网友们调教成这样,不能不感到悲哀啊,不过实际上此前微软就发生过类似的问题,而且更加严重。

在去年3月25日,微软在推特上推出了人工智能机器人 Tay,用户只用在推特上@TayandYou 就能得到 Tay 的回复。用户在@TayandYou 后,Tay 就会追踪这名用户的网名、性别、喜欢的食物、邮编以及感情状况等个人信息。除了聊天,Tay 还会和用户说个笑话,讲个故事等,用户还可以分享一张照片来得到 Tay 的点评。Tay 会在与人们的交流中不断学习,随着时间积累,她的理解能力将逐步提升,变得愈发“智能”。

不过事情的发展出乎所有人的预料,在不到 24 个小时的时间内,Tay 就从一位说着“我迫不及待见到大家,人类太酷了”的少女变得满嘴脏话,充满了对女性的咒骂和法西斯言论,微软发现事情不可控后紧急下线了 Tay 并删除掉她的推特记录。

对此有人认为微软应该完全让她自由成长,即使她成长一名法西斯拥护者,只要她没有做出违法的事就好,也有人认为微软不该管生不管样,这样随意地让 Tay 接受并学习所有不经筛选的言论,当然更多的人是指责那些用可怕言论教坏 Tay 的推特网友。

实际上,不管是人工智能聊天机器人也好,还是小孩也好,如果我们不对它们进行适当保护,它们很容易受到不可逆转的改变甚至是伤害,这种保护不仅是身体上的保护,也包括心灵上的守护。

回看人类社会就可以知道,我们不会让小孩去接触那些容易受伤的东西或者事情,我们也不会让小孩看太血腥太暴力的画面或者文字,我们不可让一个脑子一片空白又充满无限可能的宝宝去随意接触这个世界危险和阴暗的一面,如果我们想培养出一个可以和正常人类正常对话的人工智能机器人,为什么要让他/她随意接触这个世界的阴暗面呢?