深色皮肤识别错误率降低20倍,微软在改善“算法的偏见”

高层速读

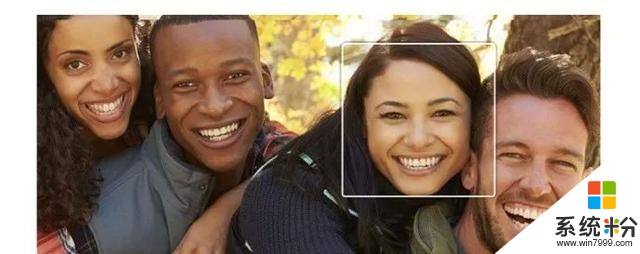

关键信息:微软面部识别API更新,将深色皮肤识别错误率降低20倍,将所有女性面部识别的错误率降低9倍,它收集了不同肤色、性别和年龄的新数据,提高了算法性别分类器的精确度。

关键意义:改善了算法模型中的偏见,为全球计算机视觉平台的公平性贡献了一份力。

在微软今天发布的博客中,其宣布了一项面部识别API的更新,该更新将改善面部识别平台识别不同肤色的能力,这也是计算机视觉平台面临的一个长期挑战。

随着这些更新,它能够将深色皮肤识别错误率降低20倍,将所有女性面部识别的错误率降低9倍。

多年来,面部识别系统一直存在种族偏见的敏感性。一项研究显示,在非裔美国人的面孔上,来自安全厂商的面部识别技术被广泛使用,但比识别其他肤色人种的准确率要低5-10%;中国、日本、韩国的算法在识别白种人上也比黄种人有优势;2015年谷歌曾经将软件工程师的一位黑人朋友认定为大猩猩,而不得不站出来赔礼道歉。

为了解决这个问题,微软的研究人员修改并扩展了脸部API的训练和数据集,并收集了不同肤色、性别和年龄的新数据,提高了算法性别分类器的精确度。

微软纽约研究实验室高级研究员汉娜沃勒克在一份声明中说:“我们讨论了不同的方法来发现偏见和公平运作;我们讨论了数据收集工作的种类,以使训练数据多样化;我们与讨论了在部署前对系统进行内部测试的不同策略。”

根据微软博客文章,该公司还在人工智能系统开发过程中建立了检测和减轻不公平的试验。微软Bing团队正与道德专家合作,探索如何在搜索结果中显示“女性CEO的缺乏”。微软指出,在《财富》500强中,只有不到5%的CEO是女性,而“CEO”的网页搜索结果主要是男性的形象。

“如果我们正在的训练机器学习系统是由有偏见的,那么它做出的决策必然会复制它的偏见。”沃勒克说,“这是一个机会,让我们真正思考我们在系统中反映的价值观,以及它们是否是我们想要系统中反映的.”

幸运的是,微软并不是唯一一家试图将算法偏差最小化的公司。

今年5月,Facebook宣布了“公平流程”,该流程将自动提醒用户,如果一种算法基于他或她的种族、性别或年龄对一个人做出了不公平的判断;IBM Watson团队最近的研究也集中在降低人工智能模型中的偏见方面,特别是面部识别。